Open Source GPAI: Rechte und Pflichten nach dem EU AI Act

Einführung: Open Source Modelle im Kontext des AI Act

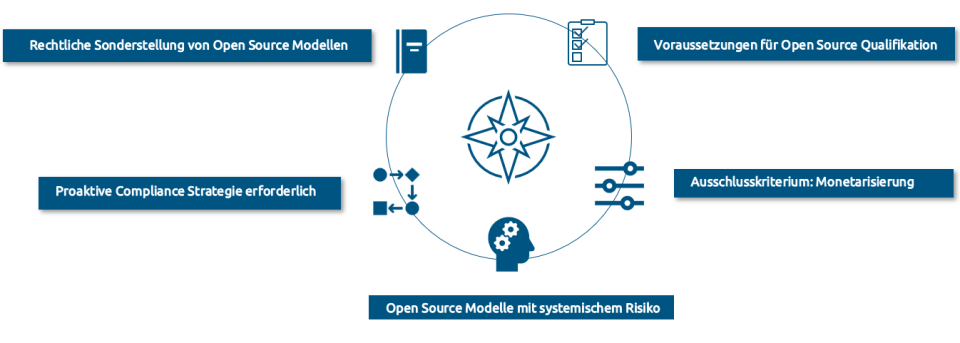

Open Source Modelle nehmen im Rahmen des AI Act sowie des Code of Practice eine ausgeglichene Position ein. Anbieter solcher Modelle profitieren von einer Befreiung von bestimmten Pflichten, die in den Artikeln 51 bis 56 des AI Act festgelegt sind. Der Code of Practice und die begleitenden Leitlinien der Europäischen Kommission finden keine Anwendung auf Open Source Modelle. Dennoch bedeutet dies nicht, dass diese Modelle vollständig außer der Reichweite des AI Acts stehen. Im Folgenden werden die relevanten Ausnahmen und spezifischen Regelungen erörtert, die für Open Source Modelle von Bedeutung sind.

Voraussetzungen für die Open Source Qualifikation

Die Ausnahme gemäß Artikel 53 Absatz 2 AI Act setzt voraus, dass ein Modell an bestimmte Bedingungen gebunden ist. Erstens muss es unter einer freien und quelloffenen Lizenz veröffentlicht werden, die den Zugang, die Nutzung, die Modifikation und die Verbreitung des Modells gestattet. Zusätzlich sind technische Informationen über das Modell erforderlich. Diese beinhalten unter anderem:

- Die relevanten Parameter, einschließlich der Gewichte.

- Details zur Modellarchitektur.

- Informationen zur Nutzung des Modells.

Diese Anforderungen stützen sich auf Erwägungsgrund 102, der davon ausgeht, dass ein hohes Maß an Transparenz und Offenheit bei Open Source Modellen vorhanden ist. Die Erfüllung dieser Kriterien ist entscheidend, um als Open Source Rechnung getragen zu werden.

Monetarisierung als Ausschlusskriterium

Ein weiterer wichtiger Aspekt bezüglich der Open Source Qualifikation ist die Monetarisierung des Modells. Laut Erwägungsgrund 103 ist die bloße Bereitstellung eines Modells über offene Repositories, wie GitHub oder Hugging Face, nicht ausreichend, um die Qualifikation zu gewährleisten. Zudem gilt die Ausnahme nicht, wenn das Modell monetarisiert wird, sei es durch:

- Direkte Monetarisierung über Preisgestaltungen.

- Indirekte Monetarisierung, etwa durch technischen Support oder Zusatzdienste inklusive API-Zugang.

- Datenmonetarisierung, insbesondere durch Verwendung personenbezogener Daten mit wenigen Ausnahmen.

Diese Kriterien sind maßgeblich für die Rechtsprechung und die Einschätzung, ob ein Modell tatsächlich als Open Source gilt oder nicht.

Ausnahme von der Ausnahme: Systemisches Risiko

Open Source Modelle, die mit einem systemischen Risiko assoziiert sind, unterliegen nicht der Ausnahme des Artikel 53 Absatz 2. Ein systemisches Risiko wird definiert als ein Modell mit einem Trainingsaufwand von mindestens 10²⁵ FLOPs, wie in Artikel 51 Absatz 2 AI Act festgelegt. Obwohl diese Modelle von zusätzlichen Anforderungen wie der Bewertung und Minderung systemischer Risiken befreit sind, müssen sie dennoch Transparenzpflichten nach Artikel 53 Absatz 1 erfüllen. Dies führt zu erheblichen regulatorischen Erleichterungen im Vergleich zu vergleichbaren geschlossenen Modellen, die ebenfalls systemische Risiken aufweisen.

Compliance-Strategie für Open Source Anbieter

Um den Privilegien der Ausnahme gemäß Artikel 53 Absatz 2 AI Act gerecht zu werden, muss sichergestellt werden, dass kein systemisches Risiko besteht. Es ist wichtig zu beachten, dass der Schwellenwert von 10²⁵ FLOPs durch technologische Entwicklungen rasch überschritten werden kann. Der Entwicklungsstand der Modelle erfordert eine proaktive Compliance-Strategie, die essentielle Punkte umfasst:

- Orientierung an den relevanten Kapiteln des Code of Practice.

- Dokumentation gemäß den Richtlinien der Kommission.

- Erhebung der Informationen, die im Model Documentation Form gefordert werden, darunter Lizenzart, Trainingsprozess, genutzte Daten und ökologische Bilanz.

Diese Maßnahmen tragen dazu bei, das Risiko von zukünftigen Rechtsvorstößen zu minimieren und die Möglichkeiten für eine Neuqualifizierung zu erleichtern.

Fazit: Herausforderungen und Perspektiven

Zusammenfassend lässt sich feststellen, dass viele derzeit als „Open Source“ beworbenen GPAI-Modelle die Anforderungen des AI Acts nicht erfüllen. Anbieter sind daher angehalten, ihre Geschäftsmodelle auf die Einhaltung des Artikel 53 Absatz 1 lit. b) zu überprüfen. Für Nutzer ist zu beachten, dass es keine Privilegierung bei der Anwendung nicht-qualifizierter Modelle gibt, was die zukünftige Ausrichtung des Marktes beeinflussen wird. Die Sichtweise und Praxis der Marktüberwachung wird entscheidend für die Auslegung der Normen sein und somit die Entwicklungen auf dem Markt weiter gestalten.